近几十年来,人工智能领域的创新突飞猛进。从像索菲亚这样能够模仿人类互动的人形机器人,到像ChatGPT这样以理解和生成类似人类文本能力而闻名的模型,甚至是集成到Echo等设备的语音控制虚拟助手Alexa,人工智能正在真正改变我们的世界。

在OpenCV日前发布的一篇博文中,团队介绍了何谓计算机视觉,它的朴素起源,这一迷人技术背后的机制,并且深入研究计算机视觉的任务,以及领先品牌如何利用其潜力来推动其业务向前发展。

1. 什么是计算机视觉?

当你全神贯注地阅读这篇博客时,无论是通过台式机、笔记本电脑、平板电脑,还是移动设备,你都可以分辨出它是设备或说出它的颜色。你能分辨物体。现在请想象一下具备这种能力的机器。

ComputerVision计算机视觉,简称CV,是人工智能的一个子领域,它帮助计算机和机器分析图像和视频。就像人类一样,智能系统可以理解视觉数据并从中提取有价值的信息。

计算机视觉的这种能力在广泛的行业中得到了应用。例如在医疗保健领域,CV在医学成像领域发挥了重要作用,可以帮助医生和研究人员诊断和理解复杂的医疗状况。在汽车行业,计算机视觉在允许自动驾驶汽车“感知”周围环境,确保道路安全导航方面发挥着至关重要的作用。

计算机视觉近年来取得了惊人的进步,这可以归因于两个关键因素:深度学习和神经网络的进步,以及大量视觉数据的可访问性。所述突破在不到十年的时间里将视觉系统的准确率从50%提高到令人印象深刻的99%。这一显著的进步展示了计算机视觉令人难以置信的潜力及其不断突破界限的能力。

更令人兴奋的是,计算机视觉市场的增长没有放缓的迹象。事实上,预计到2023年底,这一数字将达到惊人的222.7亿美元。预计到2028年,这一数字则会飙升至惊人的509.7亿美元,从2023年到2028年的增长速度达到惊人的12.56%。美国站在这个行业的最前沿,估计市场价值为83亿美元。

2. 计算机视觉的历史20世纪50年代–记录神经活动 1963年–尝试从2D图像中导出3D表示 1966年–多层神经网络 1979年–Necognitron——模仿人类视觉系统

计算机视觉的形式可以追溯到50年代。神经生理学家戴维·休伯尔(David Hubel)和托斯登·威塞尔(Torsten Wiesel)在20世纪50年代和60年代的开创性工作包括向猫和猴子展示图像阵列,同时记录神经活动。他们揭示了大脑早期视觉处理的基本原理。两人的发现包括对特定视觉特征有选择性反应的神经元的存在,从简单到复杂的信息分层处理,感受野的概念,以及方向敏感性。通过鼓舞人心的边缘检测、特征提取和分层处理算法,所述发现为计算机视觉的发展奠定了基础。休伯尔和威塞尔的研究深刻地影响了我们对视觉感知和计算机视觉领域的理解。

就在同一年,第一台图像数字扫描仪诞生了。1959年发明的数字扫描仪是VIDICON视像管。它通过将光学图像转换为电信号,使视觉信息数字化,从而帮助建立现代计算机视觉。VIDICON视像管允许计算机捕获和处理图像,为对象识别和模式分析等计算机视觉应用铺平了道路。这项技术标志着计算机视觉的发展迈出了基础性的一步。从那时起,计算机视觉已经成为从面部识别到自动驾驶汽车和医学图像分析等各种行业和技术的组成。

1963年,劳伦斯·吉尔曼·罗伯茨(Lawrence G. Roberts)以“Blockworld”开创了计算机视觉。这是一个从2D图像中获得3D表示的早期尝试。它利用边缘检测和假设检验从简单的块结构重构三维场景,为计算机视觉的关键概念奠定了基础。罗伯茨的研究强调了边缘检测、3D重建和假设驱动方法的重要性,而这都是现代计算机视觉的核心。今天,计算机视觉系统可以识别和解释各种对象和场景,并应用于自动驾驶汽车、面部识别和医学成像。这在很大程度上要归功于罗伯茨在1963年制定的基本原则。

1966年,马文·明斯基(Marvin Minsky)等人合著了《Perceptrons》一书,并强调了单层神经网络在处理影响计算机视觉的复杂非线性数据方面的局限性。这项研究促使人们转向多层神经网络,并重新燃起了对所述领域的兴趣。它影响了更先进的神经网络架构和训练技术的发展,为现在在计算机视觉和人工智能中占主导地位的现代深度学习奠定了基础。明斯基的研究阐明了克服早期人工智能模型局限性的重要性,塑造了计算机视觉研究和更广泛的人工智能领域的发展轨迹。

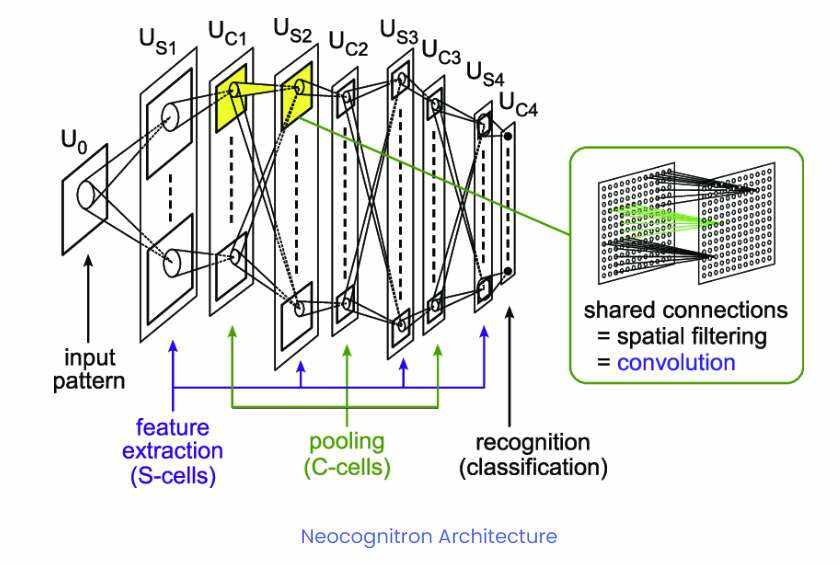

1979年,福岛邦彦推出了Neocognitron神经网络设计,重塑了计算机视觉领域的格局。

这种创新的结构模仿了人类视觉系统的结构和功能,具有像s细胞和c细胞这样的人工神经元层。Neocognitron擅长局部特征提取,检测图像中复杂的图案和边缘。最重要的是,它引入了平移不变性,使它能够不论位置或方向而识别对象。这是一个关键的概念,至今仍在使用。福岛邦彦的Neocognitron为先进的神经网络铺平了道路,尤其是主导了现代计算机视觉,并为从图像识别到对象检测的应用提供了动力卷积神经网络CNN。

3. 计算机视觉的工作原理?

计算机视觉使计算机能够像人类一样感知和理解视觉世界。它涉及多个阶段,从通过摄像头或传感器捕获图像或视频帧开始。这种原始的视觉输入然后经过旨在提高数据整体质量和可靠性的预处理技术。我们来快速浏览一下不同的阶段。

3.1 特征提取

特征提取是计算机视觉的一个关键步骤。在这个阶段,系统仔细检查输入的视觉数据,以识别和隔离重要的视觉元素,如边缘、形状、纹理和图案。所述特征至关重要,因为它们是后续分析阶段的构建块。为了便于计算机处理,识别的特征会转换成数字表示,以有效地将视觉信息转换成更易于机器理解和操作的格式。

3.2 对象检测

在这个过程中,目标检测和识别起着举足轻重的作用。一旦提取特征并转换成数字数据,系统的算法就会在图像中识别和定位特定的对象或实体。这使得计算机不仅可以检测到对象的存在,同时可以判断它们是什么。这种能力可以在从自动驾驶汽车识别行人到识别入侵者的安全系统等领域得到应用。

3.3 图像分类

图像分类将这种理解水平提升到更高的高度。

图像分类不仅仅是识别单个对象,而是将整个图像分类到预定义的类或类别中。这就是卷积神经网络CNN发挥作用的地方。CNN是专门为图像相关任务设计的一类深度学习模型。它们擅长学习复杂的特征层次,使得它们能够辨别复杂的图案,并对图像进行高度准确的分类。

3.4 对象跟踪

目标跟踪是视频分析中的一项基础技术,在视频分析中起着举足轻重的作用。它包括监控和跟踪对象在视频连续帧中移动的能力。这似乎是一项简单的任务,但从监视和体育分析到机器人等,它是广泛应用的重要组成。

3.5 语义分割

如果我们更深入地研究计算机视觉领域,我们会遇到一个更复杂、更强大的概念,即语义分割。

这种技术通过精心标记图像中的每个像素及其各自的类别,从而将对象分析提升到一个全新的水平。想象一下,机器看着一张照片,不仅要识别对象,而且要理解每个像素的边界和类别。这种级别的粒度打开了一个全新可能性的世界,特别是在自主导航领域。

自动驾驶汽车和无人机等自动导航在很大程度上依赖于语义分割。它使得车辆能够探测和识别对象,并对周围环境有详细的感知。这种理解对于做出实时决策和在复杂环境中安全导航至关重要。

但计算机视觉的能力并不止于此。它能够从2D图像中提取三维信息,从而创造3D模型和重建。这个功能在将2D图像转换为3D表示可以提供宝贵见解的建筑、考古和虚拟现实等领域都有应用。

另外,计算机视觉可以非常精确地执行后处理任务。它可以对图像中的对象进行计数,或者以令人难以置信的精度估计它们的大小。想想它在库存管理、制造业的质量控制、甚至在保护工作中监测野生动物种群方面的潜力吧。

计算机视觉令人着迷的一点是它的适应性。通过机器学习的力量,系统可以随着时间的推移而学习和进化。当处理更多的数据和获得更多的经验后,它们会变得越来越准确和可靠。这种适应性使得计算机视觉能够不断突破各种行业和应用的界限。

4. 计算机视觉的主要特征

在本节中,我们将深入研究定义计算机视觉领域的关键功能。

4.1 视觉感知

计算机视觉的核心是尝试复制人类感知和处理视觉信息的能力。它通过捕获和理解来自摄像头和传感器的图像或视频数据来实现这一目标。系统可以充当数字眼睛,允许机器能够“看到”并理解它们的环境。

4.2 形象的理解

计算机视觉的关键功能之一是图像理解。在这里,复杂的算法和模型开始发挥作用,努力剖析图像或视频帧的内容。从对象和场景到人,这个过程包括识别各种各样的元素,并理解它们在视觉环境中的属性和关系。

4.3 模式识别

模式识别是一系列计算机视觉任务的核心。机器学习识别视觉数据中反复出现的模式或特征。这包括形状、纹理、颜色和各种复杂细节的识别,它们构成了我们视觉世界的基石。

4.4 机器学习和深度学习

计算机视觉的核心是机器学习和深度学习技术。包括卷积神经网络在内的尖端技术允许计算机视觉系统自动地从视觉数据中学习和提取相关特征。它们是这一领域取得显著进步的推动力。

计算机视觉的实际应用横跨众多行业,使其成为当今世界的变革力量。从医疗保健的关键医学图像分析到汽车行业对自动驾驶的追求,计算机视觉发挥着关键作用。所述技术可以通过产品识别和推荐来帮助零售,通过监测作物和预测产量来提高农业,通过监控和面部识别来加强安全性,并通过增强现实和虚拟现实在娱乐领域增加一层沉浸式体验。

4.5 多学科特征

计算机视觉是一个非常跨学科的领域。它从各个学科汲取知识和灵感,包括计算机科学、机器学习、数学、神经科学、心理学和物理学。来自不同领域的见解的融合使得以惊人精度理解和解释视觉数据的系统创建成为可能。

5. 计算机视觉任务

现在我们来探索重要的计算机视觉任务。

5.1 图像分类

计算机视觉的核心是图像分类。这项基本任务涉及将输入图像分类为预定义的类或类别。想象一个可以简单地通过分析图像来区分猫和狗的系统。这种基本能力是其他各种计算机视觉应用的基础,并为高级视觉识别铺平了道路。

5.2 对象检测

除了分类之外,对象检测同时增加了另一层复杂性。它可以识别图像中的对象,并通过在它们周围绘制边界框来精确定位它们的位置。想想自动驾驶汽车识别行人和其他车辆,安全系统检测入侵者,或者零售应用程序跟踪商店货架的产品。对象检测允许机器能够更有效地导航和与世界交互。

5.3 图像分割

图像分割就是根据颜色、纹理或形状等共同特征,将图像分割成不同的区域或片段。这种技术有助于理解对象边界,并在图像中分离不同的对象或区域。在医学领域,它有助于分割器官或肿瘤,而在机器人领域,它有助于导航和操作任务。

5.4 面部识别

面部识别是一种基于面部特征来识别和验证个体的艺术。从通过身份验证和访问控制来增强安全性,到在娱乐中添加有趣的滤镜,以及帮助执法部门从监控录像中识别嫌疑人,这项技术有着深远的应用。

5.5 姿态估计

姿态估计确定图像或视频中对象或身体部位的空间位置和方向。例如,它可以用于健身跟踪、手势识别和游戏,使得机器能够详细了解物理世界和人类运动。

5.5 场景理解

通过从视觉数据中提取更高层次的信息,场景理解超越了对象识别。它包括识别场景的布局,理解对象之间的关系,以及推断环境的背景。这种能力对于机器人、增强现实和智能城市的导航、情景感知信息叠加和交通管理等任务至关重要。

5.5 光学字符识别

OCR即光学字符识别,是一种从图像或扫描文档中识别和提取文本的卓越能力。它在数字化印刷或手写文本中起着关键作用,使得字符变得可搜索和可编辑。应用范围从文档管理到文本翻译和视障人士无障碍工具。

5.6 图像生成

计算机视觉同时促进了图像的生成和处理。像GANs样的生成式模型可以创建逼真的图像,为艺术表达、内容生成和训练机器学习模型的数据增强打开了大门。

这只是诸多计算机视觉任务中的一部分,在解决复杂现实世界问题方面存在其他大量的变体和组合。在深度学习和神经网络进步的推动下,计算机视觉使机器能够以复杂的方式解释视觉世界并与之交互。

6. 企业如何利用计算机视觉

在当今快速发展的技术环境中,企业越来越多地转向计算机视觉以获得竞争优势。但部署计算机视觉解决方案通常是一个重大的挑战,需要计算机视觉工程师、开发人员和数据科学家的广泛努力。下面我们来看看行业领头羊是如何利用计算机视觉实现相关目标。

6.1英特尔

英特尔是一家著名的美国跨国技术公司,以其在制造半导体芯片、微处理器和各种计算机和电子设备硬件组件方面的专业知识而闻名。英特尔成立于1968年,一直是塑造当代计算机行业的关键参与者,他们在CPU技术方面的开创性进步一直十分著名。英特尔的处理器广泛应用于个人电脑、服务器和其他各种计算设备。

英特尔提供了一套全面的工具和资源来帮助企业利用计算机视觉的力量。 端到端AI管道软件:署计算机视觉解决方案的关键障碍之一是模型开发和部署的复杂性。英特尔认识到这一挑战,并开发了端到端的人工智能管道软件以简化整个流程。相关软件配备了为流行框架量身定制的优化,可确保视觉工程师可以高效地工作并优化性能。 英特尔分发:对于寻求进一步简化部署的企业,英特尔提供了OpenVINO工具包的英特尔分发版。这个强大的工具允许团队编写一次AI解决方案代码并将其部署到几乎任何地方。令OpenVINO特别有价值的是它的开源性质,可支持你避免供应商锁定。从边缘设备到云,这种灵活性允许你构建跨硬件平台无缝扩展的应用程序。 英特尔Geti:英特尔认识到,人工智能模型的开发并不仅仅局限于程序员。为了弥合领域专家和数据科学家之间的鸿沟,英特尔推出了英特尔Geti。这是一个开源的企业级计算机视觉平台使得非编码人员能够与数据科学家有效合作,加快了构建和训练人工智能模型的过程。 满足不同需求的硬件组合:英特尔明白不同的计算机视觉应用程序有不同的硬件要求。为了解决这个问题,他们提供了广泛的硬件组合,提供了在不同环境中部署计算机视觉所需的处理能力。无论你是需要在无人机或其他边缘设备运行人工智能模型,英特尔的硬件选项都可以满足你的需求。 可扩展的开源工具:英特尔对开源的承诺延伸到了它的软件工具。开发人员和数据科学家可以利用开源解决方案来开发和优化在各种异构设备无缝扩展的应用程序。

从简化模型开发和部署到提供多样化的硬件组合和开源解决方案,英特尔提供的全面硬件和软件工具可以帮助企业利用计算机视觉的全部潜力。借助英特尔的人工智能计算机视觉平台,企业可以自信地驾驭人工智能管道的各个方面,并最终提高性能并加速投资回报。

6.2英伟达

人工智能正在迎来业务转型的新时代,但它的快速集成带来了重大挑战。对于企业而言,维护一个安全稳定的人工智能软件平台是一项复杂的任务。

为了解决所述问题,英伟达推出了NVIDIA AI Enterprise。这个云原生软件平台简化了人工智能应用程序的开发和部署,包括生成式人工智能、计算机视觉和语音人工智能。所述平台为依赖人工智能的企业提供了关键的优势,例如提高生产率,降低人工智能基础设施成本,以及从试点到生产的平稳过渡。

NVIDIA AI Enterprise同时构成了专门用于生产工作流程的NVIDIA Maxine。

在一个虚拟会议已经成为常态的时代,视频会议的质量已经占据了中心位置。NVIDIA Maxine是一套尖端的GPU加速人工智能技术,并已经加快了通过计算机视觉改变通信的步伐。

Maxine是一个全面的软件库,包括人工智能解决方案工作流、框架、预训练模型和基础设施优化。Maxine旨在实时增强音频和视频质量,提升增强现实效果。它通过标准麦克风和摄像头设备实现了令人印象深刻的结果,并且可以部署在本地、云端或边缘。

下面我们来探讨一下Maxine如何利用计算机视觉来彻底改变视频会议体验。

Maxine的突出特点之一是它能够在视频通话中毫不费力地删除或替换背景。多亏了计算机视觉,你现在几乎可以在任何地方参加会议,不需要绿屏。无论你是想投射一个专业的形象或添加一个触摸奇思妙想与虚拟背景,Maxine都使之成为可能。Maxine的主要特点包括: 面部增强:Maxine使用计算机视觉进行实时面部对齐和美化,确保视频通话时的外观。 水晶般清晰的音频:Maxine擅长音频增强,有效地去除原始的背景噪音,实现无噪声的音频。 注视校正:Maxine使用计算机视觉调节注视方向,模拟眼神接触,增强自然互动。 超分辨率:Maxine采用人工智能对低分辨率视频进行upscale和增强,从而提供更清晰、更细致的质量。 手势和情绪识别:Maxine通过计算机视觉识别手势和情绪,促进互动体验。 语音增强:Maxine可以减少回声,消除背景噪音,确保虚拟会议中清晰的语音。 语言翻译:Maxine提供实时语言翻译,实现国际会议的无缝沟通。

通过为人工智能开发和部署提供全面的生态系统,英伟达使得企业能够释放人工智能的全部潜力。

6.3高通

高通的视觉智能平台正在重塑消费者和企业物联网领域的计算机视觉格局。这个强大的平台将图像处理与先进的人工智能功能无缝结合,提升了智能摄像头产品在一系列物联网设备中的性能。从企业和安全摄像头到工业和家庭监控摄像头,高通的平台是将设备视觉人工智能集成到安全、零售、制造、物流等应用中的推动力。

获得了CES设计与工程奖认可的iOnRoad应用程序就是一个例子。所述殊荣来自消费电子协会CEA,并强调了这个平台对计算机视觉技术的创新使用。CV利用视频输入和高速计算来识别给定视场内的形状。就iOnRoad而言,CV巧妙地与手机摄像头结合在一起,可以精确检测附近的对象。

以下是高通视觉智能平台的几个技术亮点: FastCV forSnapdragon:平台利用了FastCV。这个强大的工具增强了图像处理和机器学习能力,从而使得骁龙处理器更擅长处理复杂的计算机视觉任务。 在10-15%的整体性能提升中,高通对卓越的承诺显而易见,确保了智能摄像头产品的无缝高效运行。 图像转换速度在计算机视觉应用中至关重要。高通的平台在这方面表现出色,YUV420图像到RGB格式的转换速度提高了30%。

除了技术方面的出色表现之外,高通的视觉智能平台同时带来了巨大的商业优势: 高通的视觉智能平台为计算机视觉提供了简单的集成,使其易于访问且不复杂。 它将计算机视觉功能扩展到低于1ghz的处理器,扩展了中间层设备的可能性。 所述平台通过先进的图像处理和人工智能技术彻底改变了物联网设备,简化了集成,改变了行业。

6.4 Meta

Meta正在其平台和产品中利用计算机视觉来创造更身临其境的体验,并且用于提高用户的安全性。以下是Meta如何利用计算机视觉的简要分析。 内容审核:Meta使用计算机视觉从其平台自动识别和删除禁止的内容。 图像识别:计算机视觉标记照片和视频中的个人,以便更轻松地标记照片。 增强现实:CV将数字对象叠加到现实世界中,以获得沉浸式AR体验。 广告定位:它分析视觉内容的相关广告定位。 无障碍:CV为图像生成所有文本,帮助视障用户。 营销和购物:它对Meta市场中的商品进行分类和推荐。 虚拟现实: CV可以在虚拟现实环境中进行手部追踪。 安全功能:检测自残内容并提供支持资源。 语言翻译:计算机视觉翻译图像中的文本,打破语言障碍。 增强视频理解:CV通过分析视频内容来改进视频推荐。

Meta今年在计算机视觉领域迈出了重要的一步,引入了公平性计算机视觉评估FACET,从而为人工智能设定了一个基准。这一创新工具旨在评估人工智能模型在分类和检测照片和视频中的对象和个人时的公平性。

FACET建立在一个庞大的数据集之上。所述数据集包含32000张图像,其中包含50000个个体,并由视觉工程师注释。相关图像涵盖了各种人口统计属性、职业和活动。目标是深入研究人工智能模型中可能存在的潜在偏见。

Meta的主要目标之一是鼓励更广泛的研究社区利用FACET来审查视觉和多模态人工智能任务的公平性。以这种方式,开发人员可以获得AI模型中存在的偏见的有价值见解,并努力减轻它们。

Meta引入FACET基准是朝着促进透明的公平评估迈出的一大步。

6.5索尼

索尼半导体站在计算机视觉的最前沿。他们的方法包括利用原始数据和像素的力量,以便只向上游的人工智能系统发送最相关的信息。这种创新技术令人想起物联网模型,可以减轻互联网带宽的负担和传统上负责图像处理的GPU压力。

索尼对未来的愿景十分明确,他们的目标不仅仅是分析完整的图像,而是深入研究摄像头单个像素的粒度。索尼的Aitrios实现了这一目标,这是面向企业的全栈人工智能解决方案,包括一个人工智能摄像头、一个机器学习模型和一套开发工具。

索尼半导体技术和业务创新副总裁马克·汉森(Mark Hanson)强调,对于人工智能应用而言,准确的数据更为重要。他指出,解释单个像素在这一努力中起着关键作用。 索尼堆栈:使用逻辑芯片来优化像素结构 一旦传感器捕获到图像,检测对象 处理图像数据 数据流入云服务中更大的训练模型

这一突破的核心是索尼堆栈,它配备了名为IMX500和IMX501的人工智能摄像头,能够以不同的方式处理数据以满足人工智能的需求。索尼采用了优化像素结构的逻辑芯片,通过允许更多的光线照射来提高灵敏度。逻辑芯片同时可以处理人工智能计算,从而消除了数据通过总线结构传输到GPU或CPU的需要。

一旦传感器捕获到图像,它就会在几毫秒内进行处理。输出可以表现为检测对象,如人、动物或人体姿势,并以文本字符串或元数据的形式传递。

Aitrios整合了促进人工智能模型的核心技术,包括用于边缘微控制器深度学习的尖端TinyML。索尼更进一步,将图像采集传感器与云模型直接集成。这种类似于5G蜂窝和各种传感器如何将数据馈送到云服务的整合是与微软合作的一环。传感器将成为处理边缘成像数据的端点。

处理后的数据则可以无缝地流入Azure等云服务中的大型训练模型,为人工智能训练模型提供自定义或合成数据集。一个直观的Aitrios 控制台作为管理摄像头技术的界面。它处理诸如搜索摄像头、下载固件、管理更新以及将AI模型从市场部署到摄像头等任务。

索尼Aitrios技术的应用多种多样,前景广阔。在零售环境中,它可以用来确定货架的产品可用性,优化客户流量,识别容易被盗的区域,从而提高安全性。

索尼的Aitrios代表了视觉技术的显著飞跃。这种创新的方法节省了带宽,并通过分析边缘的数据和像素使人工智能系统能够获得更准确、更细粒度的信息,而应用范围涵盖各个行业。

7. 结论

在本文中,我们介绍了计算机视觉是什么,它的机制,常见的CV任务,以及索尼和高通等公司是如何实现计算机视觉。这篇文章阐明了计算机视觉在人工智能中的重要性。计算机视觉的持续进步无疑将在广泛的行业中发挥不可或缺的作用,为创新和增长提供无数机会。

产品与服务

产品与服务

联系站长

联系站长

关于我们

关于我们